J’ai testé pour vous : les données LidarHD de l’IGN dans les Alpes.

L’IGN est actuellement en train de scanner toute la France au Lidar Haute Définition (portail : LiDAR HD | Géoservices, article détaillé et chiffres : LiDAR HD : vers une nouvelle cartographie 3D du territoire).

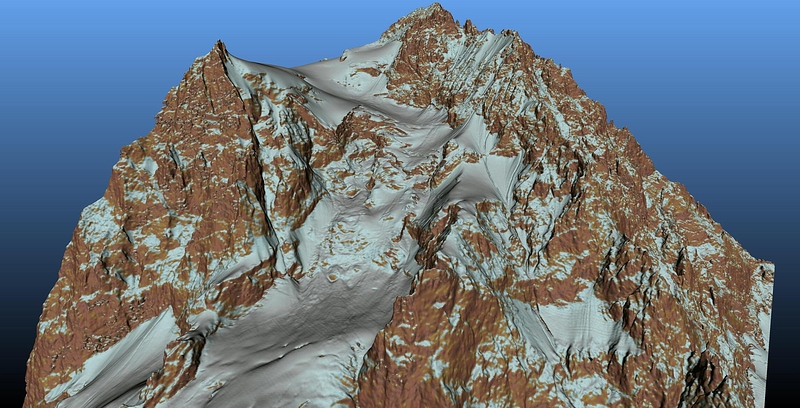

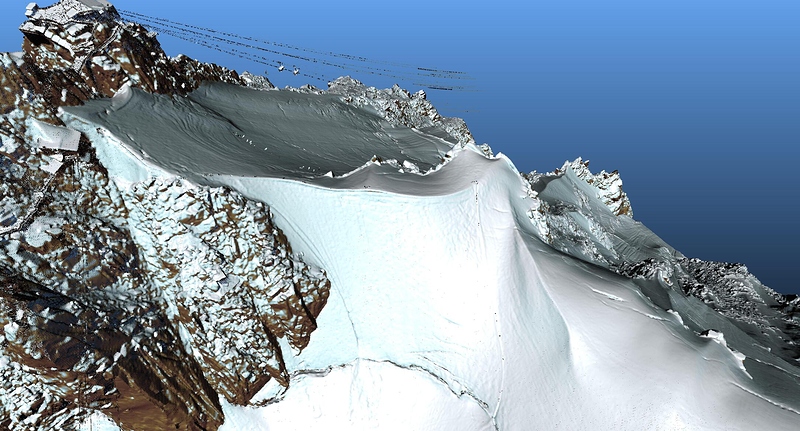

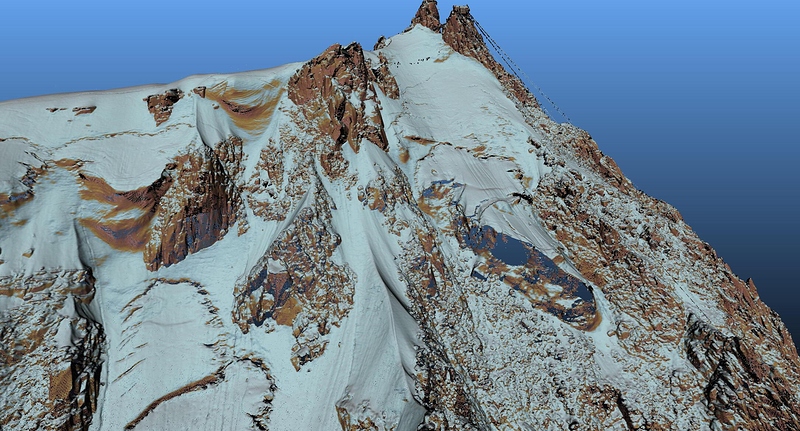

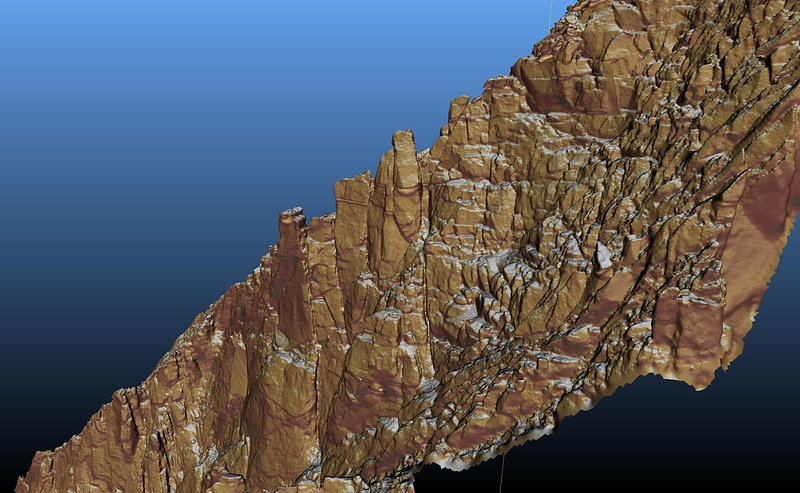

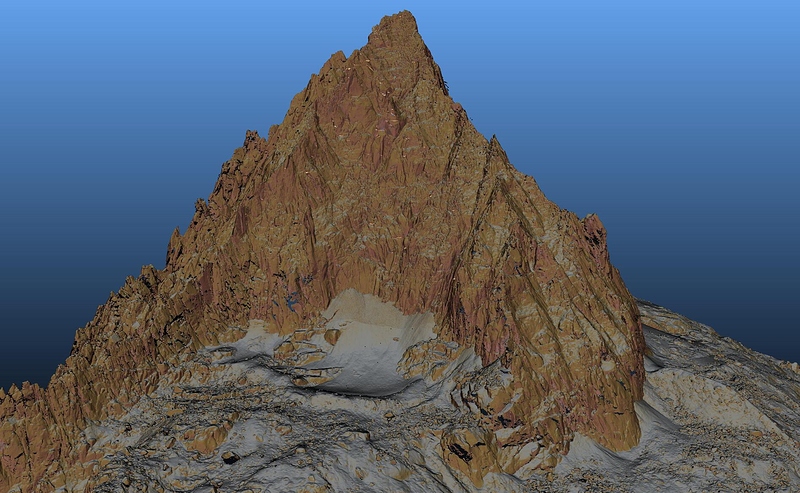

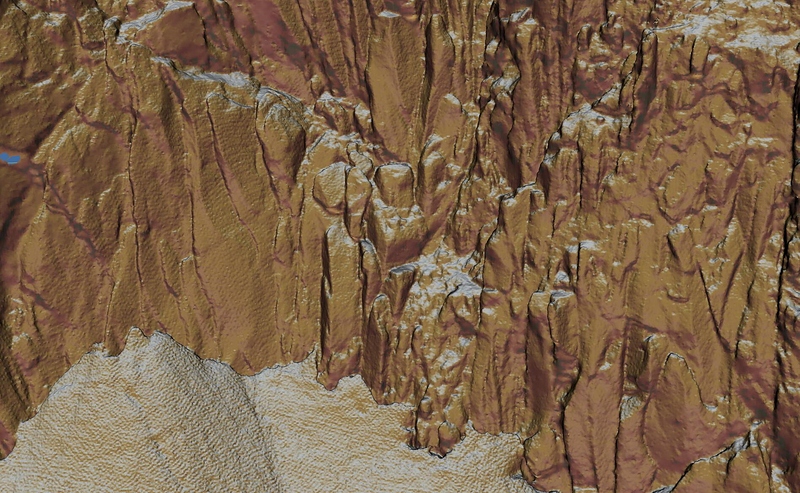

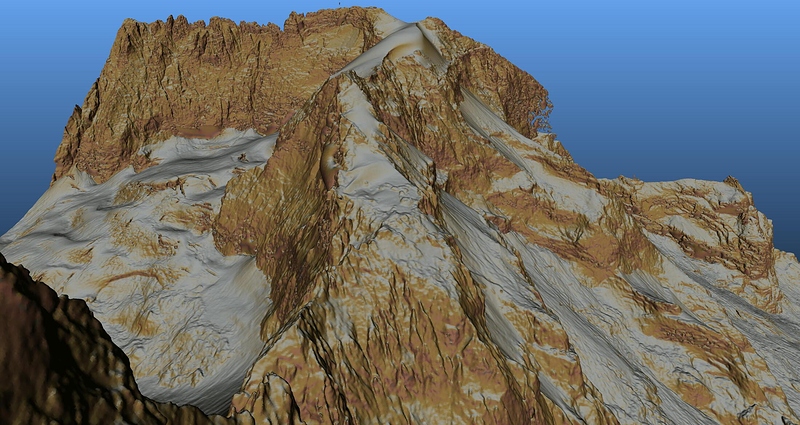

J’ai voulu tester pour la haute montagne et c’est super intéressant, la résolution est presque au caillou près : l’objectif annoncé est de 10 points/m² !

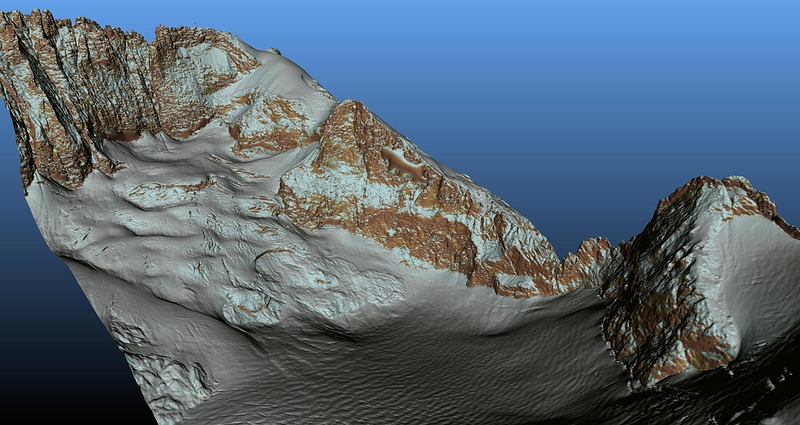

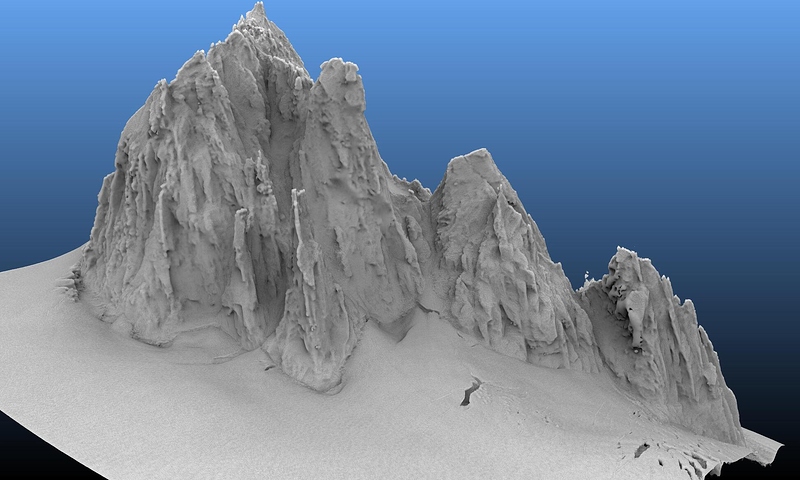

Appliqué à l’alpinisme, je trouve ça super pour préparer une course ou revoir où l’on est passé. Le scan retranscrit parfaitement les pentes de neige, même parfois les rimayes, le moindre rocher apparait, on voit chaque fissure, dièdre, surplomb…

On peut imaginer beaucoup d’utilisations pour la préparation de course, en complément des topos, ou bien pour analyser a posteriori où l’on est passé ! Je vous met des exemples en illustration.

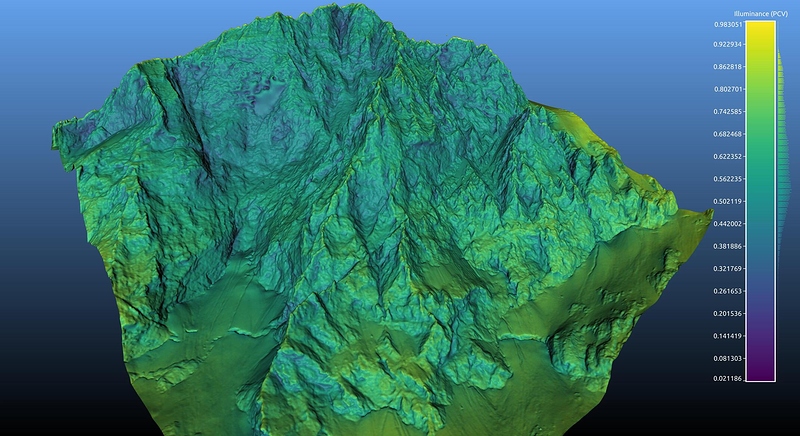

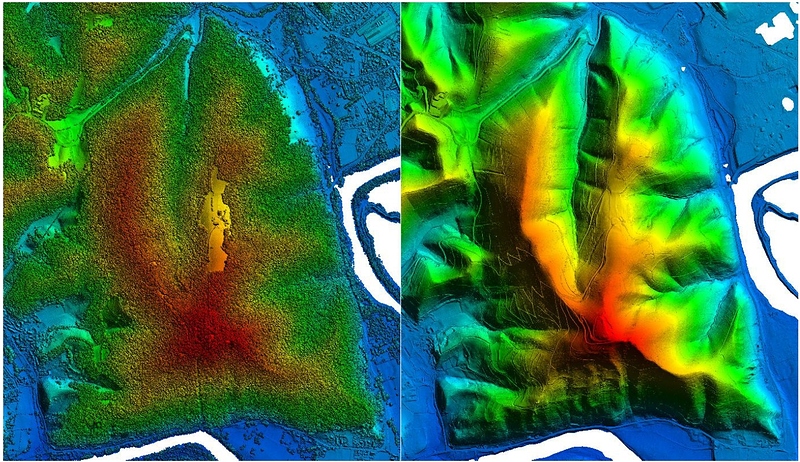

Cela pourra servir aussi à générer des cartes avec un relief bcp plus détaillé : courbes de niveau et ombrage de bien meilleure qualité.

Pour l’instant, il n’y a pas encore d’interface grand public de consultation, pour faire les images présentées ici, il faut être bon bidouilleur si l’on n’est pas géomaticien pour manipuler les fichiers des nuages de points, les convertir en maillage 3d et les visualiser correctement. J’ai travaillé avec le logiciel libre CloudCompare. À terme je pourrais faire un tuto car j’ai désormais trouvé les bons réglages en quelque sorte, pour que chacun puisse faire ça dans son coin. Par contre, pour ce qui serait de créer un site web de consultation de ces sommets en 3D, si quelqu’un veut m’aider ça serait un super projet, mais je ne m’y connais pas assez pour l’instant !

Côté IGN, il y aura bien sûr une nouvelle plateforme de consultation des données brutes de LidarHD, il y aura aussi un nouveau modèle de terrain numérique (MNT) plus détaillé à l’échelle française. Mais je ne sais pas si il y aura un jour une sorte de GoogleEarth Ultra HD où l’on visualise des surfaces 3D, pas des nuages de points bruts. Ces surfaces, pour être générées, nécessitent des traitement de données du nuage spécifique pour chaque environnement : l’avantage avec la haute montagne c’est qu’il n’y a ni végétation ni bâtiments pour brouiller. J’ai voulu essayer pour le Caroux (couvert de forêts), ma méthode de travail serait à revoir car la végétation complexifie énormément la chose.

Pelvoux, Glacier des Violettes, super à manipuler en 3D pour comprendre l’enchaînement des rappels du parcours de la descente

Aiguille du Midi, arête nord, vue en contreplongée de la sortie du téléphérique. en contrebas à droite, l’éperon Frendo. On voit des alpinistes descendant l’arête.

Aiguille du Midi, face nord, éperon Frendo. Noter le câble du téléphérique

Aiguille du Moine, Arête Sud : gendarme en Té et gendarme Diamant. à droite, le labyrinthe de la face sud où passe la voie normale

Aiguille du Moine, face sud complète

Aiguille du Moine : attaque de la face sud. On voit la rimaye un peu ouverte, la plate-forme du dernier rappel, et le début de la vire diagonale pour aller à l’arête sud.

Barre des Écrins face nord à droite, face sud à gauche avec au fond le pic Coolidge.

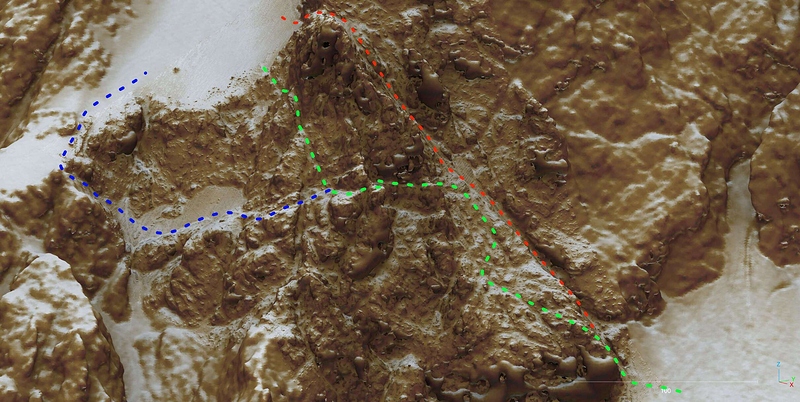

Vires de l’Ailefroide Orientale. En rouge, le couloir de neige, en vert, le trajet que j’ai fait quand j’y suis allé. En bleu : trajet normal ? je me souviens avoir hésité au milieu de la pente avant de rebrousser chemin.

Le Râteau E arête sud. De droite à gauche : Tête Nord du Replat, Brêche du Râteau, arête S du Rateau E, Râteau E, et à l’extrême gauche, pilier Paquet

Râteau, arête sud vue du sud

Face sud des Rouies, éperon Sud au centre (voie dite Rébuffat)

Grand Capucin et satellites. à droite, pointe Adlphe Rey